Глобальная сеть переживает фундаментальную трансформацию: на смену человеческому трафику приходят ИИ-агенты. Объем потребления контента машинами уже достигает 200 миллиардов страниц в день, что ставит крест на привычном интернете. Традиционные модели монетизации через баннеры и подписки перестают работать — боты не кликают по рекламе. Издатели вынуждены на ходу изобретать новые экономические механизмы для взаимодействия с искусственным интеллектом.

Масштаб роботизации и кризис старых моделей

Издатели столкнулись с беспрецедентным наплывом автоматизированного трафика. Отдельные статьи сканируются ботами сотни тысяч раз, а некоторые материалы собирают по 50 000 посещений роботами всего за сутки. Возможности человека ограничены дефицитом внимания — в среднем мы просматриваем не более 200 страниц в день. У ИИ-агентов таких лимитов нет. Современные поисковые платформы на базе нейросетей обрабатывают десятки цитат на один запрос, в то время как живой пользователь обычно переходит лишь по паре ссылок.

Бизнес-модели, опирающиеся на рекламные показы и партнерские ссылки, становятся бесполезными, когда основным посетителем сайта оказывается алгоритм. В 2024 году это спровоцировало волну судебных исков против разработчиков ИИ. Однако к 2025 году стратегия изменилась: издатели начали рассматривать ИИ не как угрозу, а как новую демографическую группу. Машинам нужен специфический пользовательский опыт, и эта адаптация напоминает революцию мобильного интернета прошлых лет.

Новая экономика: от скрапинга к оплате за использование

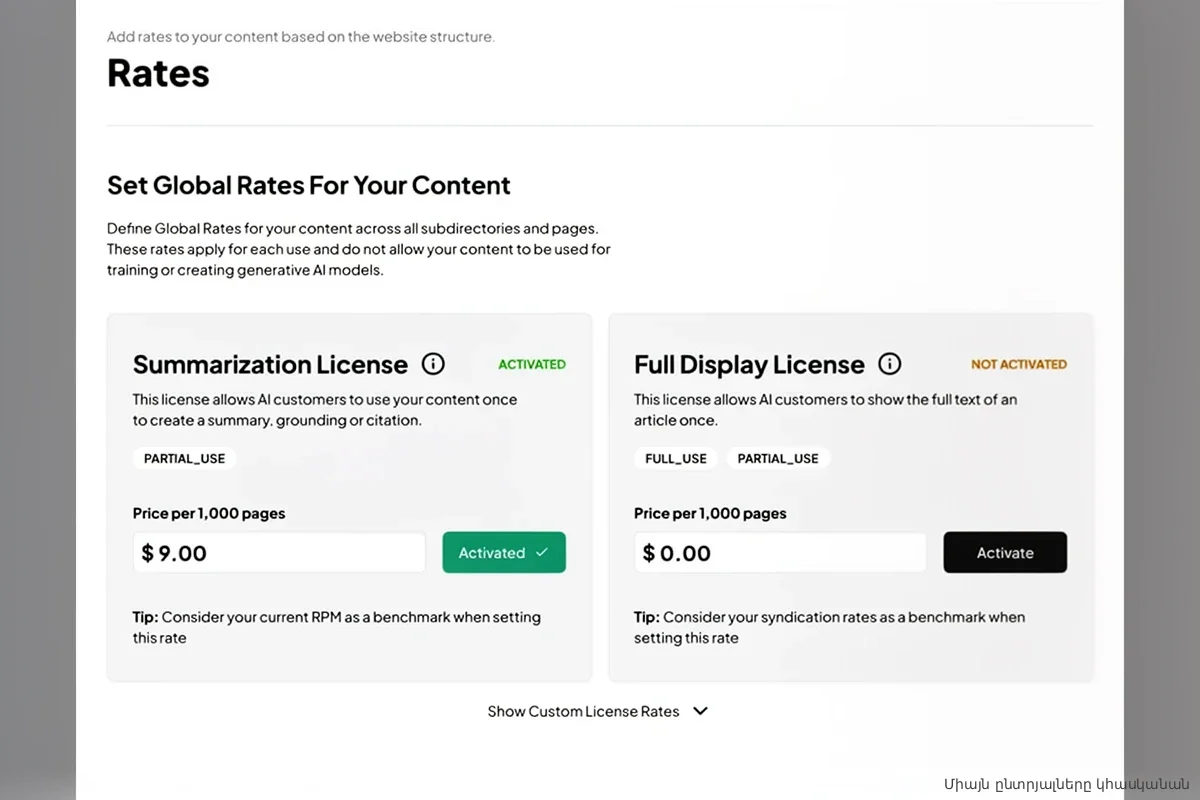

Рынок переходит от разовых сделок по продаже архивов к модели оплаты за контент в режиме реального времени. Появились специализированные платформы, которые помогают медиа мониторить и монетизировать бот-трафик, используя привычную метрику CPM — стоимость за тысячу показов. К подобным сервисам уже присоединились тысячи издателей, включая крупнейшие мировые журналы.

Ключевым решением стала технология Retrieval Augmented Generation (RAG). Она позволяет ИИ-приложениям извлекать актуальный контент без переобучения базовых моделей, создавая для СМИ поток возобновляемого дохода. При этом внедряется динамическое ценообразование: доступ к свежим финансовым отчетам или срочным новостям обходится разработчикам ИИ дороже, чем развлекательный контент.

Технологическая адаптация и «двухслойный» интернет

Чтобы эффективно общаться с ИИ-агентами, сайты меняют свою структуру. На смену тяжелому HTML приходит лаконичный Markdown. Это снижает затраты на передачу данных и экономит «окно контекста» нейросетей, удаляя лишний визуальный шум. Современные инструменты автоматизируют этот процесс, превращая сложные макеты страниц в структурированный текст, понятный алгоритмам.

Сеть фактически разделяется на две среды: одну — для людей, другую — для машин. Меняется и подход к кибербезопасности. Издатели больше не могут тратить огромные ресурсы на защиту от совершенных ботов, поэтому внедряют модель «запрещено по умолчанию». Посетитель — будь то человек или программа — должен сначала доказать свою благонадежность. Также активно используются «мягкие пейволлы»: эксклюзивные и свежие данные скрыты от ботов, а в открытом доступе остаются только архивные материалы.

Специализированные протоколы и серверы берут на себя техническую сложность интеграции. Это позволяет медиа адаптироваться к вебу, управляемому естественным языком, без необходимости раздувать штат инженеров.