Эпоха, когда дипфейки можно было распознать на глаз, осталась в прошлом. В 2025 году только официальные потери от ИИ-мошенничества превысили 893 миллиона долларов, а число жалоб в спецслужбы перевалило за 22 тысячи. Технологии достигли такого совершенства, что в ловушки злоумышленников попадают даже опытные эксперты по кибербезопасности: инстинкты и визуальный опыт больше не гарантируют защиты.

Масштаб угрозы: от школьников до пенсионеров

Инструменты для клонирования голоса и создания цифровых двойников стали бесплатными, анонимными и пугающе простыми в освоении. Специалисты по безопасности подчеркивают: реальный ущерб значительно выше официальной статистики, так как многие жертвы скрывают факт обмана из-за чувства стыда. Преступники действуют точечно. Пожилых людей атакуют через фальшивые инвестиции и легенды о «родственниках в беде», молодежь шантажируют поддельным интимным контентом, а работающее население среднего возраста заваливают гиперреалистичными фишинговыми письмами и фальшивыми счетами.

Арсенал цифровых аферистов

Одной из самых циничных схем остается имитация голоса близких. Известны случаи, когда родители получали звонки с мольбами о помощи от «детей», чей голос был полностью синтезирован нейросетью. Набирает обороты и метод «забоя свиней» — долгая психологическая обработка жертвы через чат-ботов для выманивания крупных сумм. Не пощадили мошенники и рынок труда: теперь они проводят многоэтапные видеоинтервью, используя дипфейки топ-менеджеров известных корпораций. Итог всегда один — просьба оплатить рабочее оборудование или передать доступы к банковским картам.

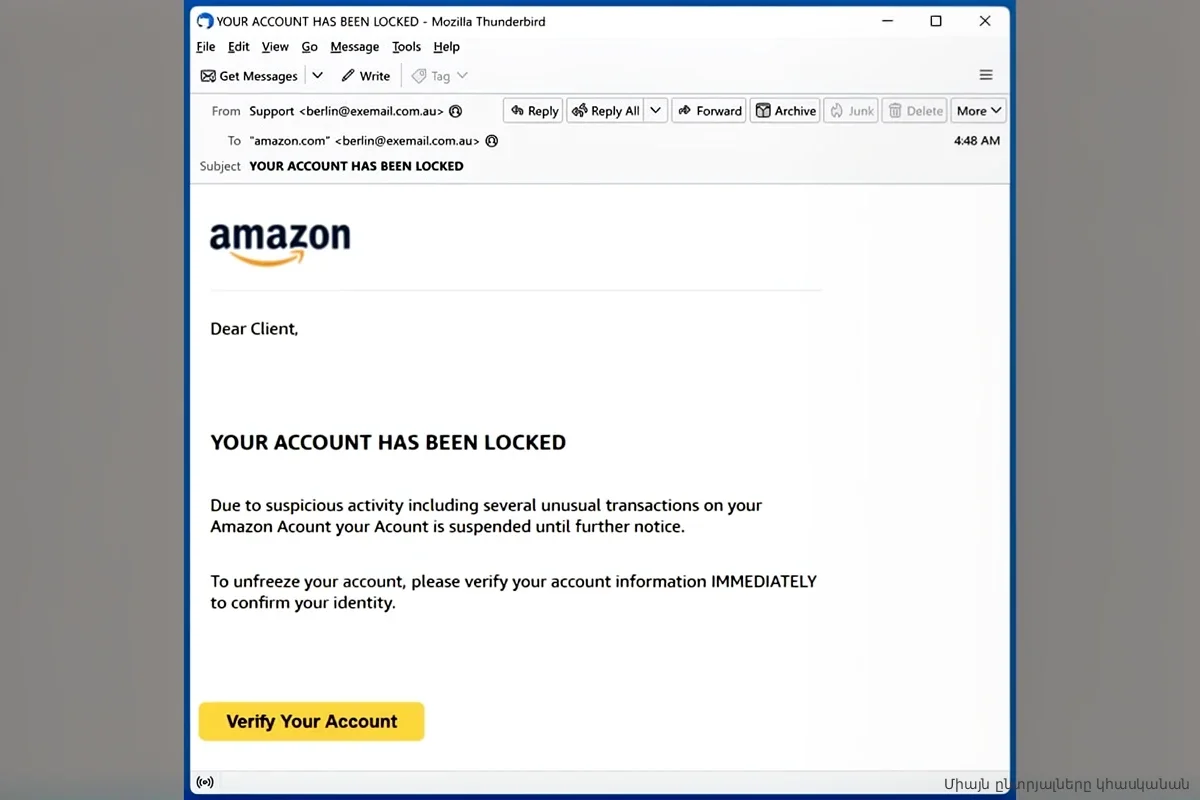

Ловушки в PDF и магазины-призраки

Новым фронтом атак стали бесплатные онлайн-редакторы документов и сервисы для налоговых деклараций. Эти инструменты незаметно копируют все вводимые данные, создавая идеальный фундамент для персонализированного взлома. В онлайн-торговле расцветает «триангуляция»: ИИ мгновенно генерирует убедительные витрины магазинов. Покупатель оставляет данные карты на таком сайте, после чего мошенники покупают товар у реального продавца на украденные деньги и отправляют его жертве. Так преступники заметают следы, а человек узнает о краже со счета с большим опозданием.

Как вычислить подделку в 2026 году

Современные нейросети научились рисовать руки и текст без ошибок, поэтому старые советы больше не работают. Чтобы распознать обман, нужно смотреть на физику процесса. Ищите несоответствия в тенях, «замыленные» текстуры волос при сильном приближении и аномальные блики в глазах. Во время подозрительного видеозвонка попросите собеседника повернуться в профиль: большинство алгоритмов обучаются на фронтальных кадрах и начинают «плыть» при резком повороте головы. В аудиозаписях ИИ выдает отсутствие вдохов и неестественно быструю реакцию на реплики.

Стратегия выживания в цифровой среде

Лучшая защита сегодня — это договоренность о секретных кодовых словах внутри семьи или команды. Если звонок кажется подозрительным, немедленно кладите трубку и перезванивайте человеку сами по проверенному номеру. Если деньги уже ушли, счет идет на часы — это единственный шанс отозвать транзакцию. Откажитесь от SMS-подтверждений в пользу приложений-аутентификаторов и менеджеров паролей. Помните: ИИ не изобрел новые способы обмана, он просто сделал классическую социальную инженерию дешевой, массовой и пугающе правдоподобной.